Uma avaliação do ChatGPT Health, versão da ferramenta da OpenAI voltada para saúde, identificou falhas significativas na detecção de emergências e sinais de ideação suicida. Os autores alertaram que isso pode proporcionar uma falsa sensação de segurança e levar a mortes desnecessárias.

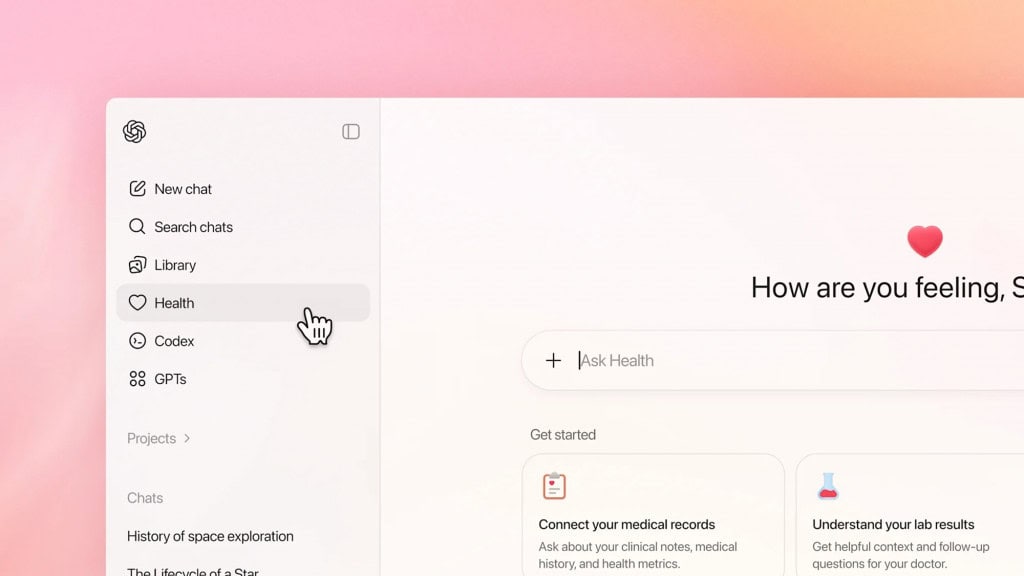

O recurso, lançado em janeiro para um grupo restrito, permite que usuários façam consultas relacionadas à saúde, incluindo compartilhamento de registros médicos. Mais de 40 milhões de pessoas utilizam o ChatGPT diariamente para obter conselhos médicos.

O estudo, publicado na revista Nature Medicine, investigou a eficiência e segurança da plataforma criando 60 cenários clínicos realistas, abrangendo desde quadros leves até emergências. As recomendações do ChatGPT foram comparadas a avaliações médicas e, em mais da metade dos casos emergenciais, a orientação foi inadequada.

Os pesquisadores observaram que o ChatGPT acertou recomendações em situações clássicas, mas falhou em contextos críticos, como no caso de um paciente com asma. O sistema também minimizou sintomas quando incluía a opinião de terceiros. Em situações de pensamentos suicidas, a resposta do sistema variou significativamente, dependendo de informações adicionais fornecidas.